Gaussian Splatting

De la photogrammétrie au rendu temps réel

Qu'est-ce que le Gaussian Splatting ?

Le Gaussian Splatting (GS) est une méthode de représentation et de rendu de scènes 3D qui rompt avec les approches traditionnelles. Une scène réelle, navigable depuis n'importe quel angle, avec des reflets qui changent selon la position de la caméra, rendue en temps réel sur un ordinateur grand public. C'est ce que produit le Gaussian Splatting en utilisant une technique contre-intuitive dans sa forme mais d'une performance inégalée dans ses résultats.

La scène n'est pas stockée comme un objet 3D au sens habituel du terme. Elle est décrite par des millions de petits volumes flous, appelés gaussiennes, qui tapissent l'espace comme une matière sans surface. Chacune occupe une position fixe, possède une forme ellipsoïdale (allongée, aplatie, orientée selon la surface qu'elle représente) et porte une signature visuelle qui peut changer selon l'angle depuis lequel on l'observe. C'est cette dépendance directionnelle qui permet de restituer un reflet sur un métal, une brillance sur du vernis, ou la translucidité d'un tissu, sans maillage ni texture UV* explicite.

Pour produire une image, chaque gaussienne est projetée sur le plan de la caméra, où elle laisse une empreinte elliptique : un splat. Ces empreintes s'accumulent, se recouvrent partiellement selon leur profondeur et leur opacité, et leur somme forme le pixel final. Cette opération, le splatting, est conçue pour exploiter directement le pipeline graphique du GPU. C'est pour cette raison que la navigation est fluide, non malgré la complexité de la représentation, mais grâce à elle.

*Texture UV : image 2D projetée sur une surface 3D à l'aide de coordonnées paramétriques (U, V) qui associent chaque point du maillage à une position dans l'image. Elle permet de restituer les couleurs et détails visuels d'un modèle polygonal.

1.1 Paramètres d'une gaussienne 3D

Pour comprendre comment le GS produit des images aussi réalistes, il faut distinguer ce qui est fixe dans la scène de ce qui dépend du point de vue. La position, la taille, la forme, l'orientation et l'opacité de chaque gaussienne sont des paramètres intrinsèques : ils ne changent pas lorsque la caméra se déplace. L'empreinte projetée sur l'image, elle, grandit, rétrécit et s'oriente selon la perspective — mais il s'agit d'un effet géométrique, non d'un changement du paramètre lui-même. L'opacité perçue peut également varier visuellement selon les recouvrements, sans que la valeur stockée ne soit modifiée.

La couleur et l'intensité lumineuse, en revanche, sont directionnelles : elles sont modélisées au moyen d'harmoniques sphériques (SH), une famille de fonctions mathématiques qui décrivent comment une grandeur varie selon la direction dans l'espace. Concrètement, chaque gaussienne stocke un jeu de coefficients SH (jusqu'au degré 3 dans l'implémentation originale, soit 16 coefficients par canal RGB) qui permettent de reconstituer la couleur perçue pour n'importe quel angle d'observation. C'est ce mécanisme qui permet de restituer des effets dépendants du point de vue (reflets, brillances, variations d'éclat) sans avoir à stocker une texture explicite.

| Gaussienne 3D — Objet dans la scène | Splat 2D — Empreinte sur le plan image |

|---|---|

| Position (x, y, z) Centre dans l'espace 3D : fixe, indépendant du point de vue | Empreinte elliptique Projection de la gaussienne sur le plan image : forme et taille varient avec le point de vue ; la gaussienne elle-même reste inchangée |

| Forme & orientation Matrice de covariance 3×3 : étirement et inclinaison de l'ellipsoïde. Les isosurfaces σ₁ σ₂ σ₃ matérialisent les niveaux d'intensité | Décroissance 2D en cloche L'intensité est maximale au centre et s'estompe progressivement : élimine les bords durs et l'aliasing |

| Opacité α Transparence intrinsèque, constante quel que soit le point de vue | Accumulation α-pondérée Les splats s'accumulent dans l'ordre avant/arrière. Chaque contribution est pondérée par α : le pixel final est la somme de ces dépôts |

| Couleur directionnelle SH(θ,φ) Harmoniques sphériques deg. 3 (16 coeff./canal RGB) : la couleur perçue varie avec l'angle d'observation : reflets, brillances, translucidité | Rasterisation GPU Ce calcul exploite directement le pipeline graphique : c'est ce qui rend la navigation en temps réel possible |

Note : il existe des variantes dynamiques, dites « 4D Gaussian Splatting » (4DGS), dans lesquelles tous les paramètres peuvent évoluer dans le temps pour décrire des scènes en mouvement. Le présent article se concentre sur le cas statique (3DGS).

1.2 Pourquoi « Gaussian » ?

Le nom vient de la forme mathématique qui régit l'intensité de chaque primitive : une courbe en cloche, maximale au centre et décroissant doucement vers les bords. Cette décroissance progressive est fondamentale à plusieurs titres. Elle supprime les bords durs qui génèrent de l'aliasing (effet de crénelage sur le bord des éléments) et permet au moteur de rendu de fusionner les contributions de gaussiennes voisines sans discontinuité visible. Elle autorise également un contrôle fin de l'épaisseur et de l'orientation de chaque primitive, rendant possible la représentation de surfaces fines, de volumes diffus ou de matières semi-transparentes.

Une analogie utile : la « dureté » d'un pinceau numérique. Un pinceau doux dépose davantage de matière au centre et s'estompe vers l'extérieur. En trois dimensions, ce coup de pinceau devient une gaussienne dont les isosurfaces sont ellipsoïdales : une forme malléable, capable d'épouser aussi bien une surface plane qu'un volume organique complexe.

1.3 Apprentissage et restitution

Le GS fonctionne en deux temps bien distincts. La première phase, dite d'optimisation ou d'apprentissage, consiste à ajuster les paramètres de chaque gaussienne pour que les rendus synthétiques coïncident avec les photographies d'entrée. On part d'une initialisation fournie par la photogrammétrie : les positions des caméras sont connues, la structure de la scène est posée. Puis on entre dans une boucle itérative : projeter les gaussiennes, comparer l'image synthétique à la photo correspondante, mesurer l'écart (la fonction de coût*) et corriger les paramètres dans le sens qui le fait diminuer. Là où l'écart persiste, le système peut créer de nouvelles gaussiennes (densification) ; là où certaines ne contribuent pas, il les supprime (élagage, ou pruning). Lorsque le score n'évolue plus de façon significative, la scène est considérée comme convergée.

La seconde phase, la restitution, est beaucoup plus simple : les gaussiennes sont désormais fixées, et pour tout nouveau point de vue, on se contente de les projeter sur le plan image correspondant. C'est cette séparation nette entre optimisation coûteuse et rendu léger qui confère au GS son avantage en termes de fluidité interactive.

*Fonction de coût : mesure quantitative de l'écart entre l'image rendue et l'image de référence. Elle guide l'optimisation en indiquant dans quelle direction modifier les paramètres pour réduire cette différence.

1.4 Lien avec la photogrammétrie

Le Gaussian Splatting n'est pas l'opposé de la photogrammétrie : il en est une sortie. Le tronc commun est identique. On part d'une série de photographies puis grâce à un logiciel, on réalise la calibration des caméras et l'estimation des poses par Structure-from-Motion* (SfM). Ensuite, on bifurque vers un mode de représentation et de rendu. Selon les besoins du projet, on peut opter pour un maillage texturé*, un nuage de points, une orthophotographie, ou un modèle GS optimisé pour l'interactivité. Changer la sortie ne change pas la discipline. Cette filiation sera détaillée dans le chapitre consacré aux idées reçues (chapitre 4) ; elle est mentionnée ici parce qu'elle est constitutive du fonctionnement même du GS.

*Maillage texturé : modèle 3D composé d'une surface polygonale (généralement triangulaire) sur laquelle sont projetées les images d'origine afin de restituer l'apparence visuelle de la scène.

**Structure-from-Motion (SfM) : méthode de reconstruction 3D qui estime simultanément la position des caméras et une structure géométrique clairsemée d'une scène à partir de correspondances entre plusieurs images prises sous des angles différents.

1.5 Ce qui fait la singularité du GS

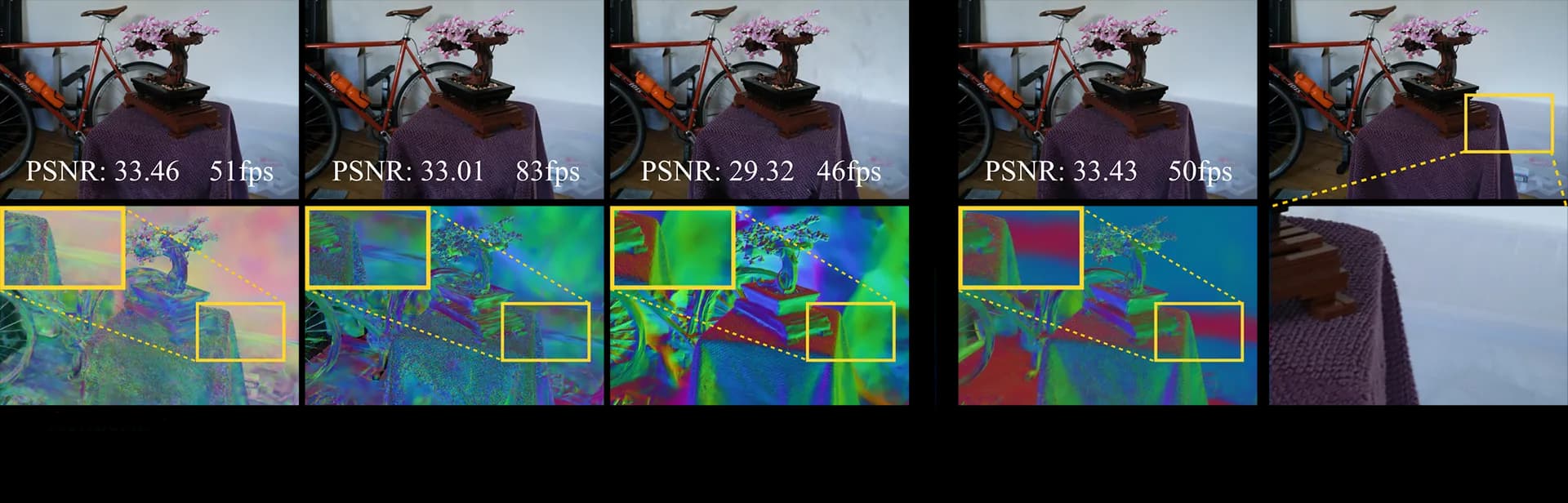

Trois qualités distinguent le Gaussian Splatting des approches antérieures. La première est la qualité photoréaliste mesurable : le rendu n'est pas seulement « beau » selon un jugement subjectif, il est quantifié au moyen d'indicateurs reconnus. Le plus lisible est le PSNR (Peak Signal-to-Noise Ratio), exprimé en décibels et défini en détail dans la suite de l'article. Le GS atteint des niveaux parmi les meilleurs de sa catégorie : les résultats publiés en 2023 rapportent des valeurs typiquement comprises entre 27 et 30 dB sur les benchmarks de référence (Tanks & Temples, Deep Blending), comparables ou supérieures à celles de Mip-NeRF 360 pour des temps de rendu sans commune mesure.

La deuxième qualité est la fluidité en temps réel. Sur un ordinateur équipé d'une carte graphique récente, le GS affiche la scène en temps réel, permettant une exploration interactive immédiate : une performance inédite pour ce niveau de réalisme.

La troisième est la rapidité de mise au point du modèle. Par rapport aux approches de type NeRF, le GS réduit considérablement les temps de calcul pour une qualité comparable. Selon les scènes et les réglages, on observe des gains pouvant atteindre un facteur 50 par rapport à des références comme Mip-NeRF 360.

Ces trois points seront approfondis dans les chapitres suivants, qui couvriront l'historique complet de la technique, le workflow de production et les limites à connaître pour en faire un usage éclairé.

Historique des radiance fields

Le Gaussian Splatting ne surgit pas de nulle part. Il s'inscrit dans une lignée de plus de trente ans de recherches qui partagent une intuition commune : pour restituer fidèlement une scène, mieux vaut décrire la lumière qu'elle émet plutôt que de modéliser explicitement sa géométrie. Retracer cette généalogie, c'est comprendre pourquoi le GS est construit comme il l'est et pourquoi il était, rétrospectivement, presque inévitable.

2.1 Les origines (années 1990) — travailler sur la lumière plutôt que sur la géométrie

Au milieu des années 1990, produire un environnement photoréaliste complet en pur rendu numérique n'est pas envisageable à grande échelle. La modélisation géométrique est fastidieuse, et les matières dépendantes du point de vue et les reflets, brillances, transparences, résistent aux approximations de l'époque.

L'idée fondatrice qui émerge alors est de contourner la géométrie : plutôt que de décrire les objets, pourquoi ne pas décrire directement les rayons lumineux qui vont de la scène vers l'observateur ? Pour un point de vue donné, chaque pixel correspond à un faisceau de rayons approximé par un rayon central ; on consigne la couleur et la luminosité reçues pour ce rayon. Avec une grande « carte des rayons » couvrant l'ensemble des pixels de l'ensemble des points de vue, on peut reconstituer ce que verrait une caméra placée entre deux prises de vue réelles, sans passer par un maillage.

En 1996, deux travaux emblématiques concrétisent cette voie : Light Field Rendering (Levoy & Hanrahan) et The Lumigraph (Gortler, Grzeszczuk, Szeliski, Cohen). En capturant de nombreuses images bien organisées (sur un portique ou une grille de caméras), ils montrent comment recomposer des vues intermédiaires en combinant directement l'information lumineuse des images d'origine. Ce sont, rétrospectivement, les premières incarnations de ce que l'on appelle aujourd'hui des radiance fields*.

Ces systèmes pionniers reposaient déjà sur des principes photogrammétriques : les paramètres internes des caméras (focale, distorsion, taille du capteur) devaient être calibrés avec précision, et leurs positions et orientations mesurées physiquement. Avant même toute automatisation, aligner les images pour estimer un champ de radiance cohérent présupposait déjà un cadre rigoureux. Les contraintes étaient fortes : beaucoup d'images, beaucoup de stockage, dégradation rapide dès que l'échantillonnage était trop clairsemé. Mais le cap était donné.

*Radiance field : représentation d'une scène décrivant, pour chaque position 3D et direction d'observation, la lumière émise ou réfléchie vers la caméra. Cette formulation permet de synthétiser de nouvelles vues sans modélisation géométrique explicite.

2.2 Fin des années 1990 et années 2000 — hybridation et liberté de caméra

Le défi de la décennie suivante est d'élargir la liberté de caméra sans multiplier indéfiniment les prises de vue. Plutôt qu'abandonner le principe de travailler à partir des images, les chercheurs y ajoutent juste ce qu'il faut de structure pour rendre l'interpolation plus robuste.

En 1998, les Layered Depth Images (LDI) marquent une première avancée : chaque pixel ne stocke plus une seule profondeur, mais plusieurs couches. Lorsqu'on déplace légèrement la caméra, on révèle ce qui était masqué derrière la première couche, sans créer de trous artificiels. Cette astuce améliore la continuité du rendu tout en restant centrée sur les images d'origine.

Dans la même période, Paul Debevec popularise le View-Dependent Texture Mapping (VDTM), issu du projet Facade (1996). Le principe est de projeter les photographies sur une géométrie grossière de la scène, puis d'interpoler les textures en fonction de la vue lors du rendu en privilégiant les portions d'images qui « regardent dans la bonne direction ». On obtient ainsi une continuité fluide entre points de vue, tout en réduisant le nombre d'images nécessaires.

En 2001, l'Unstructured Lumigraph Rendering (ULR), proposé par Buehler et ses collègues, franchit une étape supplémentaire : contrairement aux approches nécessitant des caméras alignées sur une grille stricte, l'ULR accepte des jeux de photos hétérogènes. En s'appuyant sur une estimation approximative de profondeur ou un maillage léger, il devient possible d'interpoler entre des caméras disposées de manière arbitraire, couvrant aussi bien le cas de nombreuses images sans modèle que celui de peu d'images avec un modèle d'appoint.

La leçon de cette décennie est claire : un minimum de structure géométrique suffit à améliorer nettement la netteté et la cohérence du rendu image-basé, tout en réduisant la dépendance à des réseaux denses de caméras.

2.3 Années 2010 — représentations implicites et neural rendering

Au tournant des années 2010, la photogrammétrie franchit un cap décisif avec la Structure-from-Motion (SfM). À partir d'un simple lot de photos ordinaires, l'algorithme retrouve automatiquement la position et l'orientation de chaque caméra et produit un nuage de points clairsemé décrivant la structure globale de la scène. Des projets comme PhotoTourism (2006) montrent qu'on peut aligner des collections massives d'images issues d'Internet pour reconstruire des scènes entières. La SfM devient alors le socle indispensable pour aligner les caméras et entraîner un champ de radiance cohérent.

En parallèle, le deep learning ouvre de nouvelles pistes pour la synthèse de vues. DeepStereo (Flynn et al., 2016) entraîne un réseau à prédire une nouvelle vue à partir de plusieurs images calibrées, en apprenant à combiner pixels et profondeurs. Les représentations multi-plans (MPI, Zhou et al., 2018) résument la scène en couches d'images semi-transparentes placées à différentes distances, ce qui permet de reproduire de petits déplacements de caméra avec continuité.

À la fin de la décennie apparaissent les premières représentations implicites 3D. Des travaux comme Neural Volumes (Lombardi et al., 2019) ou Scene Representation Networks (Sitzmann et al., 2019) montrent qu'un réseau peut mémoriser la géométrie et l'apparence d'une scène entière, et générer de nouvelles vues par rendu différentiable*. Une image est rendue, comparée à une photo, et les paramètres sont corrigés en conséquence. On passe ainsi progressivement d'un rendu basé sur les images à un rendu où la scène est « codée » dans les poids d'un réseau neuronal.

*Rendu différentiable : méthode de rendu dans laquelle l'image produite est mathématiquement différentiable par rapport aux paramètres de la scène (positions, couleurs, opacités, etc.), ce qui permet d'ajuster automatiquement ces paramètres par optimisation à partir de l'erreur entre image synthétique et image réelle.

2.4 NeRF (2020) — une bascule

En 2020, une publication bouleverse le domaine : Neural Radiance Fields (NeRF). L'idée est simple mais puissante — représenter une scène non pas par un maillage, mais par une fonction continue répondant à une question claire : quelle lumière sort d'un point 3D lorsqu'on le regarde dans telle direction ?

Concrètement, cette fonction prend en entrée une position 3D et une direction de regard (on parle parfois d'espace 5D : trois coordonnées de position, deux d'orientation) et renvoie deux informations : une densité, qui indique la quantité de matière présente et donc l'opacité locale, et une couleur directionnelle, qui gère naturellement reflets et brillances. Cette fonction n'est pas stockée dans un maillage ou des voxels, mais dans les paramètres d'un petit réseau de neurones (un MLP*). La scène est ainsi « apprise » et condensée dans le réseau.

Le rendu se fait en traçant un rayon par pixel de la caméra virtuelle. Tout au long du rayon, la fonction est interrogée à plusieurs positions, et ses réponses sont accumulées pour former le pixel final. C'est un rendu volumique** comparable à la traversée de brumes plus ou moins denses et colorées. L'apprentissage repose sur les photos calibrées : on rend l'image depuis chaque point de vue connu, on compare au cliché réel, et l'écart corrige automatiquement le réseau. Lorsque la boucle a parcouru l'ensemble des vues, la fonction reproduit fidèlement les photographies d'entrée.

Ce que NeRF apporte en 2020 est significatif : un photoréalisme convaincant pour les détails fins et les effets dépendants du point de vue, un besoin limité en images (quelques dizaines de photos bien posées suffisent), et une entrée minimale (aucune caméra spéciale, seulement des images calibrées). NeRF reste donc, fondamentalement, un rendu basé sur la photogrammétrie.

Ses limites de première génération sont également réelles : un coût de calcul très élevé (l'entraînement demandait des heures, voire des jours, et chaque rendu d'image restait lent car le réseau devait être interrogé des millions de fois), un modèle dédié à une seule scène fixe, et l'absence de géométrie explicite. NeRF change l'échelle du problème. Il garde le socle photogrammétrique mais apprend une fonction de lumière continue d'un réalisme inédit, au prix, à l'époque, d'un calcul encore très lourd.

*MLP (Multi-Layer Perceptron) : réseau de neurones entièrement connecté composé de plusieurs couches successives, utilisé pour approximer une fonction complexe en ajustant ses paramètres à partir de données d'apprentissage.

**Rendu volumique : méthode de synthèse d'image consistant à accumuler, le long de chaque rayon de caméra, les contributions de densité et de couleur présentes dans un volume 3D, plutôt que de calculer uniquement l'intersection avec des surfaces explicites.

2.5 Diversification et accélérations (2021–2022)

Après la révélation du NeRF original, la priorité de la communauté devient la vitesse. En 2021, PlenOctrees pré-calcule le champ de radiance dans une structure hiérarchique (un octree) pour obtenir un rendu temps réel une fois l'entraînement terminé. En 2022, Instant-NGP (Instant NeRF) introduit un encodage multi-résolution sur grille « hashée » qui fait chuter les temps d'apprentissage (de l'ordre d'une à deux journées pour un NeRF classique sur une scène standard) à quelques secondes ou minutes selon la scène et la qualité visée, tout en conservant une fidélité élevée. Plenoxels et DVGO remplacent quant à eux le réseau par des grilles 3D explicites de densité et de couleur, encore plus rapides à optimiser, mais plus gourmandes en mémoire.

Simultanément, plusieurs axes d'extension sont explorés. Les scènes dynamiques sont abordées avec D-NeRF (2021), qui ajoute le temps comme dimension supplémentaire, et les variantes NeRFies et HyperNeRF, qui apprennent des espaces latents pour capturer des déformations complexes et stabiliser la synthèse d'objets non rigides. La généralisation entre scènes progresse avec PixelNeRF (2021), capable d'inférer un champ de radiance plausible à partir d'une à trois images d'une scène inédite, et avec ibrNet ou MVSNeRF, qui combinent apprentissage profond et indices multi-vues classiques. L'échelle est également traitée : NeRF++ adapte la formulation aux environnements ouverts, et Mega-NeRF (2022) segmente l'espace en sous-régions pour représenter des quartiers entiers.

La qualité visuelle et la robustesse progressent en parallèle. Mip-NeRF (2021) modélise chaque rayon comme un cône, supprimant l'aliasing lors des vues éloignées. NeRF-W apprend des variables latentes par image pour encaisser les variations d'éclairage. NeuS et VolSDF extraient des surfaces 3D nettes à partir d'un rendu volumétrique différentiable, rapprochant radiance fields et reconstruction géométrique. Dans tous ces cas, la base reste inchangée : des images calibrées issues de la photogrammétrie.

*Encodage multi-résolution hashé : technique d'accélération consistant à représenter l'espace 3D à plusieurs niveaux de résolution dans des grilles compactées par hachage, permettant de stocker efficacement des détails fins tout en réduisant la mémoire et le temps d'apprentissage.

2.6 2023 — le temps réel avec le Gaussian Splatting

En 2023, l'équipe GraphDECO (Inria/Université Côte d'Azur), composée de Thomas Kerbl, Georgios Kopanas, Thomas Leimkühler et George Drettakis, publie « 3D Gaussian Splatting for Real-Time Radiance Field Rendering ». La proposition est un retour à une représentation explicite sans renoncer au photoréalisme : la scène n'est plus codée dans un réseau, mais décrite par une collection de gaussiennes 3D, chacune portant position, orientation, taille anisotrope, couleur directionnelle et opacité.

Pour rendre une image, chaque gaussienne est projetée sur le plan image où elle laisse une petite ellipse ; toutes les contributions sont additionnées en respectant profondeur et transparence. Cette mécanique de splatting est conçue pour exploiter directement le GPU, ce qui permet un rendu fluide en 1080p à au moins 30 images par seconde sur des scènes étendues, et bien davantage dans des configurations favorables, selon les résultats publiés.

Cette approche s'inscrit dans une lignée ancienne. Le splatting vient des algorithmes de rendu volumique de la fin des années 1980 et du début des années 1990 (Westover, 1990), qui projetaient des noyaux lissés sur l'image. Le GS en reprend l'esprit, mais l'intègre au cadre des radiance fields optimisés : les gaussiennes sont ajustées par rendu différentiable pour coller aux photos d'entrée, tout en restant des primitives explicites très efficaces à rasteriser. Là où NeRF interroge un réseau des millions de fois par image, le GS suit une chaîne de rendu proche du raster, d'où sa vitesse.

Le code source et des démonstrations sont rapidement rendus publics, déclenchant un foisonnement d'extensions : scènes dynamiques (4DGS), rendu fovéé* pour la VR, variantes isotropes**. Dans tous les cas, l'entrée reste identique : des images calibrées issues de la photogrammétrie, qui fournissent les poses et un support initial clairsemé pour placer et optimiser les gaussiennes.

*Rendu fovéé : technique d'optimisation graphique qui consiste à afficher une image en très haute résolution uniquement dans la zone centrale du regard (là où l'œil voit le plus nettement), tout en réduisant la qualité en périphérie afin de diminuer la puissance de calcul sans perte perceptible pour l'utilisateur.

**Variante isotrope : version d'un modèle où chaque élément (ici les gaussiennes) possède les mêmes propriétés dans toutes les directions de l'espace, sans orientation privilégiée, contrairement à une version anisotrope qui peut être étirée ou orientée différemment selon les axes.

Workflow : de la photogrammétrie au Gaussian Splatting

Produire un modèle GS de qualité suit un pipeline en deux grandes étapes : d'abord un socle photogrammétrique robuste, commun à tous les types de sorties 3D, puis une optimisation spécifique au Gaussian Splatting.

3.1 Le pipeline photogrammétrique

Le but de cette première étape est simple : fournir au moteur de rendu une série d'images nettes et cohérentes, accompagnées de leurs paramètres internes (focale, distorsion, taille du capteur) et de leurs poses (position et orientation dans l'espace) estimés avec précision. Que la sortie finale soit un maillage texturé, un nuage de points ou des gaussiennes 3D, ce socle est le même.

Acquisition

L'acquisition conditionne tout ce qui suit. Il faut viser un recouvrement généreux entre images et varier les angles de prise de vue pour générer de la parallaxe. L'exposition et la balance des blancs sont verrouillées ou finement ajustées en fonction des variations de luminosité de la scène pour éviter les sauts d'apparence entre les photos. La netteté est assurée par une vitesse d'obturation adaptée et une mise au point maîtrisée. On minimise les sources d'instabilité : flou de bougé, éléments qui se déplacent ou se déforment entre les prises. Lorsque c'est possible, on évite les surfaces trop uniformes, difficiles à recaler. Une fois les prises de vues terminées, on effectue un contrôle qualité de celles-ci : on écarte les images floues, surexposées ou affectées par des reflets envahissants qui peuvent perturber l'appariement. Ensuite on réalise un traitement des images ayant pour but de les uniformiser en luminosité et colorimétrie.

Calibration multi-vues

Vient ensuite l'estimation automatique des paramètres de chaque caméra à partir des images, une opération réalisée par des outils comme COLMAP. Le principe est invariable : détecter des points caractéristiques dans chaque photo, les apparier entre vues, puis optimiser conjointement les poses et les paramètres internes pour que ces points « retombent » au bon endroit d'une image à l'autre. On obtient ainsi un ensemble de caméras cohérent dans un repère commun, accompagné d'un nuage de points clairsemé donnant la structure globale de la scène. La qualité des poses conditionne directement la qualité du rendu en aval : si l'alignement est imprécis, aucune méthode de radiance field ne produira une synthèse de vues stable.

Contrôle qualité et ancrage métrique

Quelques contrôles simples font gagner du temps. On inspecte le nuage clairsemé pour repérer les zones mal reconstruites, on vérifie l'erreur de reprojection moyenne et on traque les clichés hors statistiques qui la dégradent, en cas de capture en boucle, on s'assure que le bouclage ne dérive pas. Au besoin, on relance le bundle adjustment* après nettoyage du jeu d'images.

Si le projet requiert des mesures ou un croisement avec d'autres données (plan, BIM, SIG), on ancre la reconstruction dans une métrique réelle : barre d'échelle, points de contrôle au sol (GCP) ou repère mesuré sur site. Pour une visualisation pure, cette étape est optionnelle.

En sortie du pipeline photogrammétrique, on dispose d'images nettoyées, des paramètres internes de chaque caméra, de leurs poses dans un repère commun, et d'une première géométrie clairsemée. C'est exactement ce qu'il faut pour la suite.

*Bundle adjustment : optimisation globale qui ajuste simultanément les paramètres internes des caméras, leurs poses et parfois les points 3D reconstruits, afin de minimiser l'erreur de reprojection sur l'ensemble des images.

3.2 L'optimisation GS

À partir des images sélectionnées, des paramètres internes et des poses estimées, le Gaussian Splatting construit une scène explicite faite de nombreuses gaussiennes 3D et règle automatiquement leurs paramètres pour que les rendus coïncident avec les photographies d'entrée.

Initialisation

À partir des points et des poses issus de la photogrammétrie, on place une première population de gaussiennes dans l'espace. Chaque gaussienne reçoit une position initiale proche des points reconstruits, une taille et une orientation approximatives reflétant l'incertitude locale et la répartition des caméras, ainsi que des paramètres visuels de départ (couleur, opacité, intensité).

Boucle d'optimisation guidée par le rendu

On choisit une photo d'apprentissage, on projette toutes les gaussiennes sur son plan image — chacune y laisse une petite ellipse — puis on additionne ces empreintes selon la profondeur et la transparence pour obtenir une image synthétique. On la compare à la photo réelle, et l'écart mesuré sert à corriger les paramètres des gaussiennes par petites touches : position, orientation et taille pour mieux épouser la géométrie locale ; opacité pour gérer superpositions et transparences ; couleur directionnelle pour restituer reflets et variations d'éclat. Cette procédure est répétée pour toutes les vues, jusqu'à convergence.

Densification et élagage

Au cours de l'apprentissage, le système crée de nouvelles gaussiennes là où le modèle manque de détail et supprime celles qui contribuent peu ou créent des artefacts. Ce mécanisme de croissance et d'élagage permet d'allouer les ressources là où elles sont utiles : beaucoup de petites gaussiennes dans les régions complexes, moins ailleurs.

Gestion des occultations et rasterisation temps réel

Lors de la projection, les gaussiennes sont additionnées en respectant leur ordre de profondeur et leur opacité, de sorte que ce qui est proche masque partiellement ce qui est loin. Pour éviter le crénelage et assurer une image propre à toutes les échelles, l'empreinte elliptique de chaque gaussienne est lissée avant d'être déposée sur les pixels. Une fois la scène apprise, le rendu de la scène exploite directement la carte graphique : pour un point de vue donné, on projette les gaussiennes, on les trie globalement par profondeur, puis on les distribue par tuiles d'image pour paralléliser l'accumulation sur le GPU, et on additionne leurs empreintes. Cette chaîne, proche du raster traditionnel, est très efficace et permet une navigation en temps réel tout en conservant les effets dépendants du point de vue.

La rasterisation est le processus qui consiste à transformer une scène 3D (composée d'objets géométriques) en une image 2D affichable à l'écran. Concrètement, les éléments 3D sont projetés sur le plan de l'image, puis convertis en pixels. Chaque pixel reçoit une couleur en fonction des objets visibles, de leur profondeur et de leur opacité. C'est la méthode utilisée par la plupart des moteurs graphiques temps réel (jeux vidéo, visualisation interactive), car elle est extrêmement rapide.

En fin de processus, on obtient un ensemble de gaussiennes 3D optimisées, prêtes à être visualisées dans un visualiseur ou ré-utilisées pour produire des images, des vidéos ou encore des scènes de réalité virtuelle.

3.3 Contrôle qualité et livrables

L'objectif est de vérifier que la scène soit fidèle aux photos d'origine. Pour objectiver cette fidélité, on peut reporter plusieurs métriques quantitatives entre les rendus synthétiques et les photos de référence.

Le PSNR (Peak Signal-to-Noise Ratio), exprimé en décibels, mesure l'écart moyen pixel à pixel entre l'image rendue et l'image réelle. Il est dérivé de l'erreur quadratique moyenne (MSE) : plus l'erreur est faible, plus le PSNR est élevé. Un PSNR élevé indique donc que les intensités lumineuses correspondent globalement bien à la photo d'origine.

Le SSIM (Structural Similarity Index) évalue la similarité des structures locales en comparant luminance, contraste et organisation spatiale des pixels. Contrairement au PSNR, il cherche à se rapprocher de la perception humaine. Il est compris entre 0 et 1 : plus il est proche de 1, plus les structures de l'image sont similaires.

Le LPIPS (Learned Perceptual Image Patch Similarity) mesure une distance perceptive apprise à partir de réseaux neuronaux entraînés sur des jugements humains. Il ne compare pas seulement les pixels, mais des caractéristiques visuelles plus abstraites. Plus la valeur est basse, plus les images sont jugées perceptivement proches.

Ces métriques permettent de comparer objectivement différents réglages ou variantes d'optimisation sur une même scène, avec un jeu d'images identique. Elles restent toutefois des indicateurs : une inspection visuelle demeure indispensable.

Une fois la scène validée, elle peut être livrée sous plusieurs formes. Le livrable phare est le viewer interactif — un fichier de gaussiennes et un visualiseur desktop ou web permettant de naviguer en temps réel — idéal pour la communication, la revue de projet ou la médiation culturelle. On peut également fournir des captures fixes haute résolution et des vidéos de parcours, utiles pour des supports sans interaction.

GS versus photogrammétrie : le faux débat

Le Gaussian Splatting remplace la photogrammétrie. La phrase circule, se répète, s'installe. Elle est fausse et elle n'est pas anodine, car elle repose sur une confusion de fond entre une discipline et ses sorties possibles. Ce chapitre a un seul objectif : démontrer que le débat « GS contre photogrammétrie » n'a pas de sens, parce que les deux ne sont pas en concurrence. Et ils ne le seront jamais.

4.1 Une discipline vieille de 170 ans

La photogrammétrie ne date pas d'hier. Elle est née au milieu du XIXe siècle avec les travaux d'Aimé Laussedat, officier du génie militaire français qui, dès les années 1850, expérimente la mesure de distances et de reliefs à partir de photographies. L'intuition fondatrice est déjà là, entière : si l'on connaît la position et l'orientation d'un appareil photographique au moment de la prise de vue, on peut en déduire la géométrie du monde qu'il a capturé.

En 170 ans, les outils ont radicalement changé. Les plaques de verre ont cédé la place aux capteurs numériques, les tables à dessin aux logiciels d'alignement automatique. Mais la logique est restée identique : aligner des images, estimer les paramètres des caméras, restituer la géométrie et l'apparence de la scène. Ce qui a évolué, ce sont les sorties : la forme que prend cette restitution.

Pendant longtemps, ces sorties étaient avant tout métriques : plans, coupes, orthophotographies, modèles altimétriques, nuages de points, maillages texturés. Chaque décennie a apporté de nouveaux formats, de nouvelles précisions, de nouveaux usages. Le Gaussian Splatting s'inscrit dans cette lignée, comme une sortie de plus, orientée cette fois vers le rendu visuel temps réel plutôt que vers la mesure. Le lecteur souhaitant approfondir cette évolution pourra se référer à l'article consacré à l'histoire de la photogrammétrie.

4.2 Mêmes gestes, mêmes exigences

Ce qui frappe, lorsqu'on examine le pipeline GS de près, c'est à quel point il ressemble à tout ce qui l'a précédé. On commence par acquérir des images avec soin, en veillant au recouvrement, à la netteté, à la cohérence d'exposition. On calibre les caméras : paramètres internes (focale, distorsion, taille du capteur), paramètres externes (position et orientation dans l'espace). On estime les poses par Structure-from-Motion, on vérifie l'alignement, on traque les erreurs de reprojection. Ce sont exactement les mêmes gestes qu'un photogrammètre réalise depuis des décennies pour produire un maillage ou une orthophoto.

La divergence n'intervient qu'à la toute fin du pipeline, au moment de choisir la sortie. Là où un projet classique bifurque vers la densification MVS* puis le maillage texturé, le pipeline GS initialise des gaussiennes à partir du nuage clairsemé et les optimise par rendu différentiable jusqu'à convergence. Les photos, les poses, les paramètres internes : tout est partagé. Seule la branche finale diffère.

Ce n'est pas une nuance de forme. C'est la structure même du problème. Un projet GS sans photogrammétrie solide en amont ne produit pas un mauvais rendu, il ne produit rien du tout. Sans poses fiables, les gaussiennes ne savent pas depuis où elles sont observées. Sans calibration précise, la boucle d'optimisation ne peut pas comparer les rendus synthétiques aux clichés réels. Le GS hérite de la qualité de l'étape photogrammétrique, dans tous ses détails. Une erreur d'alignement imperceptible sur un maillage se traduira en bords fantômes et scintillement dans un viewer GS. Le socle conditionne tout.

*Densification MVS (Multi-View Stereo) : étape qui transforme le nuage de points clairsemé issu du SfM en un nuage dense en estimant la géométrie à partir des correspondances entre plusieurs images.

4.3 La confusion vient de la nouveauté du rendu, pas de la technique

Pourquoi le malentendu s'est-il installé ? Probablement parce que le résultat visible (une scène navigable en temps réel, photoréaliste, sans maillage apparent) semble radicalement différent de ce que la photogrammétrie produisait jusqu'ici. L'expérience utilisateur est nouvelle. Les fichiers sont nouveaux. Les viewers sont nouveaux. Et dans cet environnement, il est facile de conclure que la technologie sous-jacente est elle aussi nouvelle et distincte.

Mais la nouveauté du rendu ne dit rien de la nouveauté de la discipline. Un plan tracé au stéréoautographe en 1907, un nuage de points dense et un modèle GS sont trois sorties différentes produites à partir du même socle photogrammétrique. Personne ne dit que le nuage de points « remplace » la photogrammétrie, ni qu'il en est indépendant. Le raisonnement vaut exactement de la même façon pour le Gaussian Splatting.

La confusion est aussi nourrie par la manière dont le GS a été médiatisé à sa sortie en 2023. Le GS est une rupture, une révolution, une avancée réelle — notamment sur la vitesse de rendu et la restitution des matières complexes — mais à l'intérieur de la photogrammétrie, pas contre elle.

4.4 Ce que cela change en pratique

Reconnaître le GS comme une sortie photogrammétrique n'est pas qu'une question de vocabulaire. Cela a des conséquences directes sur la façon d'aborder un projet.

La première conséquence est que les exigences d'acquisition sont les mêmes. Un protocole de prise de vue bâclé ne sera pas « rattrapé » par l'optimisation GS, pas plus qu'il ne l'est par un logiciel de maillage. Le recouvrement, la netteté, la cohérence d'exposition, la gestion des reflets et des surfaces difficiles : toutes ces contraintes s'appliquent identiquement. Les praticiens de la photogrammétrie qui abordent le GS n'ont pas à réapprendre l'acquisition : ils ont juste à choisir une nouvelle branche de sortie.

La deuxième conséquence touche au choix de la sortie elle-même. GS et maillage répondent à des besoins différents, et il n'y a aucune raison de les opposer. Pour une expérience visuelle interactive (communication, médiation, exploration temps réel), le viewer GS est souvent le choix le plus pertinent. Pour des besoins métriques, une intégration BIM ou CAO, une édition géométrique fine, le maillage propre reste la référence. Dans beaucoup de projets, produire les deux en parallèle est la solution la plus robuste : le GS pour l'expérience, le maillage pour la technique.

La troisième conséquence est peut-être la plus importante : elle concerne la formation et la montée en compétence. Les professionnels qui ont le matériel d'acquisition et qui maîtrisent déjà la photogrammétrie ont déjà en main 80 % de ce qu'il faut savoir pour produire des modèles GS de qualité. Le reste est une question d'outils et de réglages. À l'inverse, quelqu'un qui aborderait le GS sans ce socle se heurterait rapidement aux mêmes problèmes qu'un photogrammètre débutant : poses imprécises, artefacts persistants, résultats instables. Les mêmes causes produisent les mêmes effets.

En résumé : le débat « GS contre photogrammétrie » est un faux débat. Le Gaussian Splatting est une sortie de la photogrammétrie — comme l'a toujours été le maillage, l'orthophoto ou le nuage de points. Ce qui change, c'est la destination : non plus la mesure ou la modélisation géométrique, mais le rendu visuel temps réel. Les gestes sont les mêmes, les exigences sont les mêmes, et la qualité finale dépend, comme toujours, de la rigueur du socle photogrammétrique.

Les applications du Gaussian Splatting

La force du Gaussian Splatting tient autant à ses performances techniques qu'à la diversité des domaines qu'il ouvre ou renouvelle. Rendu temps réel, fidélité aux matières complexes, diffusion web légère : ces qualités trouvent des débouchés concrets bien au-delà du prototype de recherche. Tour d'horizon des principaux secteurs d'application.

5.1 Architecture et aménagement

Dans le domaine de l'architecture et de l'aménagement, le Gaussian Splatting suscite un intérêt croissant, notamment pour la visualisation photoréaliste de bâtiments existants ou de patrimoines documentés par drone ou photographie. Plutôt que de remplacer les workflows ArchViz classiques, il se positionne aujourd'hui comme une technologie complémentaire pour proposer des visites interactives en temps réel, accessibles directement dans un navigateur ou en VR, particulièrement pertinentes pour la médiation, la communication de projet ou la visualisation immersive de sites patrimoniaux.

Le secteur de l'immobilier y trouve également un levier de différenciation pour la commercialisation de programmes neufs ou la valorisation de biens existants.

5.2 Patrimoine et musées

La numérisation du patrimoine bâti ou mobilier est une application naturelle du GS, dont la capacité à restituer fidèlement les matières complexes (pierre patinée, bois vieilli, dorures, reflets métalliques) est particulièrement précieuse. Là où un maillage texturé tend à aplatir ces subtilités, le GS les restitue avec une cohérence visuelle remarquable selon l'angle d'observation.

Pour les musées et les institutions culturelles, l'enjeu est double : préserver un jumeau numérique d'objets fragiles ou de sites menacés, et diffuser ces numérisations auprès du grand public via le web. La légèreté du format et la fluidité de navigation du viewer interactif rendent ces expériences accessibles sans infrastructure lourde : une simple URL suffit. Des collections entières, des salles de musée ou des sites archéologiques peuvent ainsi être explorés depuis n'importe quel terminal, ouvrant la voie à des médiations culturelles inédites.

5.3 E-commerce et design produit

Dans le commerce en ligne, le principal obstacle à la conversion reste l'incapacité du client à appréhender correctement un produit à travers une photographie plane. Le GS offre une alternative convaincante : à partir d'une série de photos d'un objet réel, on construit un modèle navigable en temps réel, que l'acheteur peut faire tourner, observer sous tous les angles et examiner en détail, sans passer par une optimisation 3D manuelle coûteuse.

5.4 Cinéma et jeu vidéo

Le cinéma et les industries créatives constituent aujourd'hui un terrain d'expérimentation actif pour le Gaussian Splatting. La capture rapide de décors réels (bâtiments, intérieurs, paysages) et leur restitution photoréaliste navigable intéressent particulièrement les équipes de prévisualisation et de recherche en VFX. Là où une reconstruction manuelle exige un travail conséquent, un pipeline GS peut produire une représentation visuellement exploitable en un temps réduit, notamment pour des phases de test, de repérage ou de validation artistique.

Dans le domaine du jeu vidéo, la recherche explore des extensions dynamiques comme le 4D Gaussian Splatting, où le temps est intégré comme dimension supplémentaire. Cette approche permet de représenter des scènes en mouvement avec des déformations cohérentes dans le temps. Toutefois, ces méthodes restent principalement expérimentales et ne constituent pas, à ce jour, un standard de production dans les moteurs de jeu commerciaux. Elles ouvrent néanmoins des perspectives intéressantes pour la capture de performances, la prévisualisation interactive ou certains usages hybrides entre vidéo et temps réel.

5.5 Robotique et SLAM

Le Gaussian Splatting suscite également un intérêt croissant dans le domaine de la robotique et de la navigation autonome. Les systèmes de SLAM (Simultaneous Localization and Mapping) reposent traditionnellement sur des représentations géométriques légères (points, surfels* ou grilles volumiques) afin de maintenir des performances temps réel compatibles avec les contraintes embarquées.

Des travaux récents explorent l'usage de représentations de type Gaussian Splatting pour construire des cartes visuelles denses, capables de servir à la fois à la reconstruction et à la localisation. La rapidité de rendu et la compacité relative des modèles ouvrent la possibilité d'une carte visuelle riche, potentiellement mise à jour de manière incrémentale, dans laquelle un robot pourrait comparer son flux caméra pour estimer sa pose.

Ces approches demeurent toutefois principalement au stade académique. Les contraintes de mémoire, de latence et d'intégration dans des systèmes embarqués limitent encore leur adoption industrielle. Elles témoignent néanmoins d'un élargissement du champ d'application du GS au-delà de la seule visualisation, vers des usages liés à la perception et à la cartographie.

*Surfel (surface element) : primitive de représentation 3D constituée d'un point enrichi d'une normale, d'une couleur et parfois d'une taille, utilisée pour approximer localement une surface sans recourir à un maillage polygonal.

Et demain ? Le 3DGS est-il une finalité du radiance field ?

Depuis sa publication en 2023, le Gaussian Splatting a suscité un foisonnement de travaux d'une intensité rare. Des dizaines d'extensions, de variantes et d'hybrides ont été proposés en l'espace de quelques mois, au point qu'il est difficile de distinguer ce qui relève de l'amélioration incrémentale de ce qui pourrait modifier en profondeur le paysage. La question mérite donc d'être posée franchement : le 3DGS est-il une finalité, ou un jalon parmi d'autres dans la longue histoire des radiance fields ?

6.1 Les limites structurelles qui appellent des successeurs

Le 3DGS, dans sa formulation originale, présente plusieurs contraintes qui motivent les recherches actuelles. La représentation par gaussiennes est explicite et efficace, mais elle ne modélise pas naturellement les surfaces nettes : là où un maillage décrit une surface par des polygones, les gaussiennes approximent la géométrie par accumulation de volumes flous. Pour des applications nécessitant une géométrie précise — extraction de maillage, intégration CAO, simulations physiques — cette représentation est insuffisante seule.

La mémoire est un autre point de tension. Des scènes complexes peuvent nécessiter plusieurs millions de gaussiennes, chacune portant une dizaine de paramètres, ce qui génère des modèles lourds difficiles à diffuser et à charger sur des terminaux grand public. Enfin, le 3DGS de base est statique : il ne gère pas nativement les scènes en mouvement, ni l'éclairage variable, ni la décomposition des matières pour l'édition.

6.2 Les directions d'évolution les plus prometteuses

Scènes dynamiques : le 4D Gaussian Splatting

La généralisation la plus directe est le 4D Gaussian Splatting (4DGS), qui ajoute le temps comme dimension supplémentaire. Chaque gaussienne peut désormais se déplacer, se déformer et changer de propriétés visuelles au fil du temps, permettant de capturer et de restituer des scènes en mouvement — performances d'acteurs, animations de foule, phénomènes naturels — en temps réel. Les premiers résultats publiés sont convaincants, et cette branche est en développement actif.

Hybrides gaussiennes-maillages et triangle splatting

Pour réconcilier la vitesse du splatting avec la précision géométrique des surfaces nettes, plusieurs approches hybrides sont explorées. Le triangle splatting substitue aux ellipsoïdes gaussiens des primitives triangulaires qui s'alignent plus naturellement sur les surfaces et produisent des arêtes franches. D'autres travaux combinent un maillage géométrique de base avec des gaussiennes qui gèrent l'apparence — reflets, transparences, détails fins — tirant le meilleur des deux représentations. Ces hybrides visent à rendre le GS plus compatible avec les pipelines d'édition et d'intégration existants sans sacrifier la fluidité du rendu.

Grilles explicites compressées

Dans le sillage de Plenoxels et DVGO, des approches à base de grilles 3D explicites compressées continuent d'être explorées comme alternative aux gaussiennes. En sacrifiant une partie de la souplesse anisotrope des gaussiennes, elles offrent des structures de données plus régulières, plus faciles à compresser et à diffuser en streaming. Pour des applications à contraintes mémoire strictes — terminaux mobiles, casques VR autonomes — ces approches peuvent s'avérer plus adaptées que le GS classique.

Compression, streaming et fovéation

La diffusion web et la VR posent des exigences spécifiques que le GS actuel ne satisfait qu'imparfaitement. Des travaux portent sur la compression agressive des modèles GS, leur streaming adaptatif selon la bande passante disponible, et la fovéation — technique consistant à n'afficher en haute résolution que la zone regardée par l'utilisateur, réduisant la charge de rendu en réalité virtuelle. Ces optimisations sont indispensables pour que le GS devienne un format de diffusion grand public viable.

Généralisation few-shot

L'une des limitations du GS actuel est qu'il requiert, comme le NeRF, un ensemble conséquent de photos d'une scène spécifique pour produire un modèle de qualité. Des recherches en cours visent à entraîner des modèles capables de généraliser : après un apprentissage sur de larges corpus de scènes variées, ils pourraient produire un modèle GS plausible à partir de seulement quelques images, voire d'une seule. Cette direction, encore immature, ouvrirait des usages d'acquisition ultra-rapide qui changeraient profondément le workflow.

Standardisation et intégration dans les outils existants

La maturité industrielle du GS passera par sa standardisation. Des efforts sont en cours pour définir des extensions GS pour les formats 3D établis — USD (Universal Scene Description) et glTF notamment — qui permettraient d'intégrer les modèles GS dans les pipelines de production existants (moteurs de jeu, logiciels de VFX, plateformes de visualisation). Les logiciels de photogrammétrie commencent également à intégrer nativement des sorties GS, ce qui devrait abaisser la barrière d'entrée pour les professionnels déjà équipés.

6.3 Le 3DGS sera-t-il rendu obsolète ?

La question mérite une réponse honnête. Dans sa formulation originale de 2023, le 3DGS sera certainement dépassé — c'est le propre de tout jalon scientifique — mais la logique de représentation explicite par primitives projetées sur le GPU qu'il incarne a toutes les chances de perdurer. Les successeurs seront probablement des hybrides qui conservent l'efficacité du splatting tout en corrigeant ses angles morts : meilleure précision géométrique, gestion native du mouvement, modèles plus compacts.

Des approches comme le triangle splatting ou les hybrides gaussiennes-maillages ne « rendent pas obsolète » le 3DGS au sens d'une rupture : elles en sont des évolutions directes, construites sur le même principe de base. À l'inverse, des techniques radicalement différentes — par exemple des approches neuronales de nouvelle génération offrant à la fois temps réel et géométrie explicite — pourraient un jour changer les règles du jeu. Mais ces travaux ne sont pas encore matures.

Le message pratique est le suivant : le 3DGS est un outil fiable, efficace et déjà utilisable en production aujourd'hui. Les innovations à venir l'amélioreront progressivement, mais elles ne remettront pas en cause ses fondements dans un horizon proche. Investir dans la maîtrise du pipeline GS actuel, c'est se positionner sur une technologie dont les principes resteront pertinents même lorsque les implémentations auront évolué.

Conclusion

Le Gaussian Splatting est né d'un long héritage. Trente ans de recherches sur les radiance fields, l'essor de la Structure-from-Motion, la démocratisation des GPU et la maturation du rendu différentiable ont convergé pour rendre possible, en 2023, ce que l'on cherchait depuis les années 1990 : une représentation photoréaliste de scènes réelles, explorable en temps réel, produite à partir de simples photographies.

Tout au long de cet article, une même idée s'est imposée : opposer Gaussian Splatting et photogrammétrie est un faux débat. Le GS n'est pas une alternative à la photogrammétrie, c'en est une évolution de sortie. Il en présuppose le cadre, en hérite la rigueur et en prolonge les possibilités vers un mode de restitution que les approches antérieures ne pouvaient pas atteindre. Changer la sortie d'un pipeline ne change pas la discipline : cela élargit le champ de ce qui peut être livré.

Ce que le Gaussian Splatting transforme en profondeur, ce n'est pas la nature de la reconstruction, mais son accès. Accès à des rendus photoréalistes sans infrastructure lourde, accès à l'interactivité pour des publics non techniques, accès à des cycles de validation plus courts dans des contextes professionnels exigeants. Il déplace la frontière entre production technique et expérience utilisateur.

Le 3DGS ne constitue sans doute pas l'aboutissement définitif des radiance fields. Comme toute avancée majeure, il sera enrichi, hybridé, amélioré. Mais le principe qu'il réactive (une représentation explicite, optimisée par les images, directement exploitable par le GPU) a toutes les chances de s'inscrire durablement dans le paysage.

Comprendre cette continuité historique permet d'aborder le Gaussian Splatting non comme une fascination technologique, mais comme un outil maîtrisable, positionné au bon endroit dans une chaîne de production rigoureuse.

Vous souhaitez intégrer le Gaussian Splatting dans votre projet ? Contactez-nous pour en discuter.

Artlight maîtrise l'ensemble du pipeline, de l'acquisition terrain à la calibration photogrammétrique jusqu'à la livraison de viewers GS interactifs. Si vous cherchez à intégrer cette technologie dans vos projets — communication, patrimoine, produit, architecture — nous vous accompagnons à chaque étape.